大侠幸会,在下全网同名「算法金」 0 基础转 AI 上岸,多个算法赛 Top 「日更万日,让更多人享受智能乐趣」

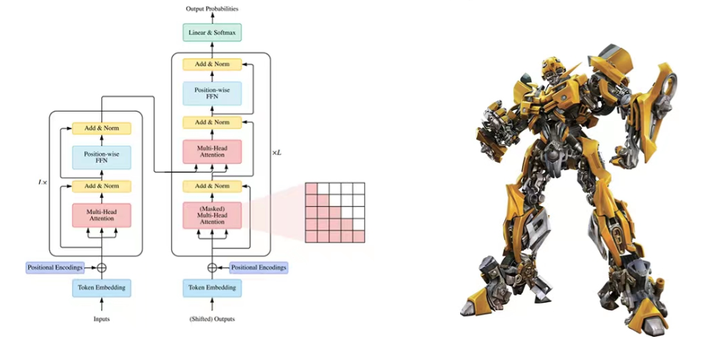

在现代自然语言处理(NLP)领域,Transformer 模型的出现带来了革命性的变化。它极大地提升了语言模型的性能和效率,而自注意力机制是其中的核心组件。

今个儿我们将通过五个阶段,逐步深入讲解自注意力机制,帮助大侠一窥其原理和应用,成功实现变身(装 X )

在处理语言和文字时,我们经常需要理解一个句子中的单词是如何相互关联的。例如,在句子“猫追着老鼠跑”中,我们需要知道“猫”是追的主体,“老鼠”是被追的对象。传统的方法在理解这些关系时有一些困难,特别是当句子变得很长时。自注意力机制是一种新的方法,可以更好地理解句子中单词之间的关系,无论句子有多长。

自注意力机制的核心思想是:每个单词都能“注意到”句子中的其他单词,并根据这些单词来调整自己。这有点像我们在读一篇文章时,会注意到一些关键的词句来帮助我们理解文章的整体意思。

在自注意力机制中,每个单词会看向句子中的其他单词,并计算一个注意力得分。这些得分表示每个单词对其他单词的关注程度。这个过程可以理解为每个单词都在问自己:“我应该关注哪些单词?”

以句子“我喜欢吃苹果”为例:

注意力得分会被一种叫做 softmax 的方法转换成概率。这种方法确保所有的得分加起来等于 1,这样我们就可以知道每个单词的重要性。例如:

每个单词会根据这些概率得分,重新组合句子中的信息,生成新的表示。这就像我们在阅读一篇文章时,会根据每句话的重要性来总结文章的核心内容。

防失联,进免费知识星球,直达算法金 AI 实验室 https://t.zsxq.com/ckSu3

在自注意力机制中,每个单词都被表示为三个向量:查询(Query)、键(Key)和值(Value)。这些向量帮助我们计算注意力得分,并生成新的单词表示。

查询向量表示我们希望了解的单词。每个单词都有一个查询向量,用于计算它与其他单词的关系。

键向量表示句子中每个单词的特征。查询向量会与键向量进行对比,计算出注意力得分。

值向量表示句子中每个单词的具体内容。注意力得分会作用于值向量,以生成新的单词表示。

以句子“我喜欢吃苹果”为例:

为了更好地捕捉句子中不同方面的信息,Transformer 引入了多头注意力机制。这个机制允许我们并行地计算多组查询、键和值向量,捕捉不同的关系。

假设我们有两个头:

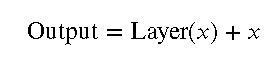

残差连接是一种技术,它通过在网络层之间添加直接的跳跃连接,帮助缓解深度神经网络中的梯度消失问题。

在每一层的输出中,我们会添加上这一层的输入。这可以用公式表示为:

其中,Layer(𝑥) 表示这一层的计算结果,𝑥 是输入。

假设我们有一个句子“我喜欢吃苹果”,经过一层自注意力机制处理后,我们会将这一层的输出与原始输入相加,生成新的表示。这使得信息更好地在网络中传播。

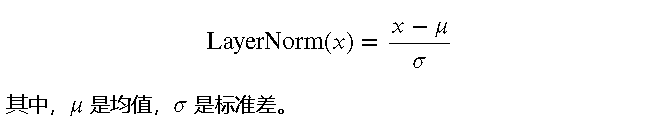

层归一化是一种技术,它通过对每一层的输出进行归一化处理,帮助加速训练和提高模型稳定性。

层归一化会对每一层的输出进行归一化处理,使得输出的均值为 0,方差为 1。这可以用公式表示为:

在每一层的输出经过残差连接后,我们会对结果进行层归一化处理,使得输出更加稳定。例如,在句子“我喜欢吃苹果”中,每一层的输出经过层归一化处理后,可以更好地进行下一层的计算。

点击 ↑ 领取

防失联,进免费知识星球,直达算法金 AI 实验室

以下是一个简化的自注意力机制的实现示例:

import torch

import torch.nn.functional as F

class SelfAttention(torch.nn.Module):

def __init__(self, embed_size, heads):

super(SelfAttention, self).__init__()

self.embed_size = embed_size

self.heads = heads

self.head_dim = embed_size // heads

assert self.head_dim * heads == embed_size, "Embedding size needs to be divisible by heads"

self.values = torch.nn.Linear(self.head_dim, self.head_dim, bias=False)

self.keys = torch.nn.Linear(self.head_dim, self.head_dim, bias=False)

self.queries = torch.nn.Linear(self.head_dim, self.head_dim, bias=False)

self.fc_out = torch.nn.Linear(heads * self.head_dim, embed_size)

def forward(self, values, keys, query, mask):

N = query.shape[0]

value_len, key_len, query_len = values.shape[1], keys.shape[1], query.shape[1]

values = values.reshape(N, value_len, self.heads, self.head_dim)

keys = keys.reshape(N, key_len, self.heads, self.head_dim)

queries = query.reshape(N, query_len, self.heads, self.head_dim)

energy = torch.einsum("nqhd,nkhd->nhqk", [queries, keys])

if mask is not None:

energy = energy.masked_fill(mask == 0, float("-1e20"))

attention = torch.nn.functional.softmax(energy / (self.embed_size ** (1 / 2

)), dim=3)

out = torch.einsum("nhql,nlhd->nqhd", [attention, values]).reshape(N, query_len, self.heads * self.head_dim)

out = self.fc_out(out)

return out

在实际应用中,可以使用预训练的 Transformer 模型,如 BERT、GPT 等,这些模型已经在大规模数据上进行过训练,能够大幅提升性能。

在特定任务上对预训练模型进行微调,即在预训练模型的基础上,使用少量的任务特定数据进行训练,以适应具体的应用场景。

为了防止模型过拟合,可以使用正则化技术,如 Dropout、权重衰减等。

自注意力机制广泛应用于自然语言处理任务,如机器翻译、文本生成、情感分析等。例如,Google 的翻译系统使用 Transformer 模型进行高效的翻译。

自注意力机制也被应用于图像处理任务,如图像分类、目标检测等。Vision Transformer(ViT)是将 Transformer 应用于图像处理的成功案例。

在第五阶段中,我们探讨了自注意力机制在实际应用中的实现步骤,提供了代码示例,并介绍了一些高级优化技巧和实际应用案例。通过这些内容,大侠可以一窥 Transformer 的核心 - 自注意力机制的实际应用和优化方法。

至此,五个阶段的学习已经完成,希望这能帮助你全面理解自注意力机制,并在实际项目中成功应用。

- 科研为国分忧,创新与民造福 -

日更时间紧任务急,难免有疏漏之处,还请大侠海涵 内容仅供学习交流之用,部分素材来自网络,侵联删

如果觉得内容有价值,烦请大侠多多 分享、在看、点赞,助力算法金又猛又持久、很黄很 BL 的日更下去;同时邀请大侠 关注、星标 算法金,围观日更万日,助你功力大增、笑傲江湖