https://zhuanlan.zhihu.com/p/633219396

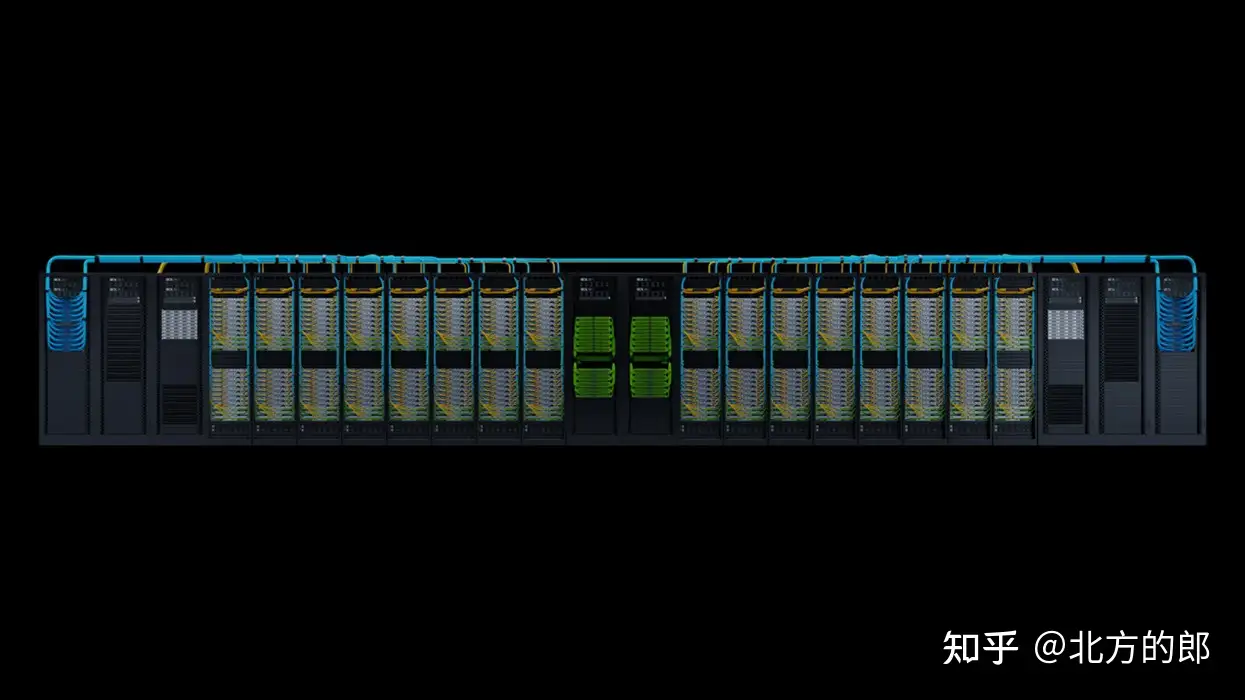

2023 年 5 月 28 日NVIDIA宣布推出 NVIDIA DGX GH200,这是首款 100 TB级别的GPU 内存系统。据英伟达称,Meta、微软和谷歌已经部署了这些集群,预计在 2023 年底之前全面上市。

在COMPUTEX 2023上,NVIDIA 发布了NVIDIA DGX GH200,这标志着 GPU 加速计算的又一次突破,为要求最严苛的巨型 AI 工作负载提供支持。过去 7 年来,GPU 的统一内存编程模型一直是复杂加速计算应用取得各种突破的基石。2016 年,NVIDIA 推出了NVLink技术和带有 CUDA-6 的统一内存编程模型,旨在增加 GPU 加速工作负载的可用内存。

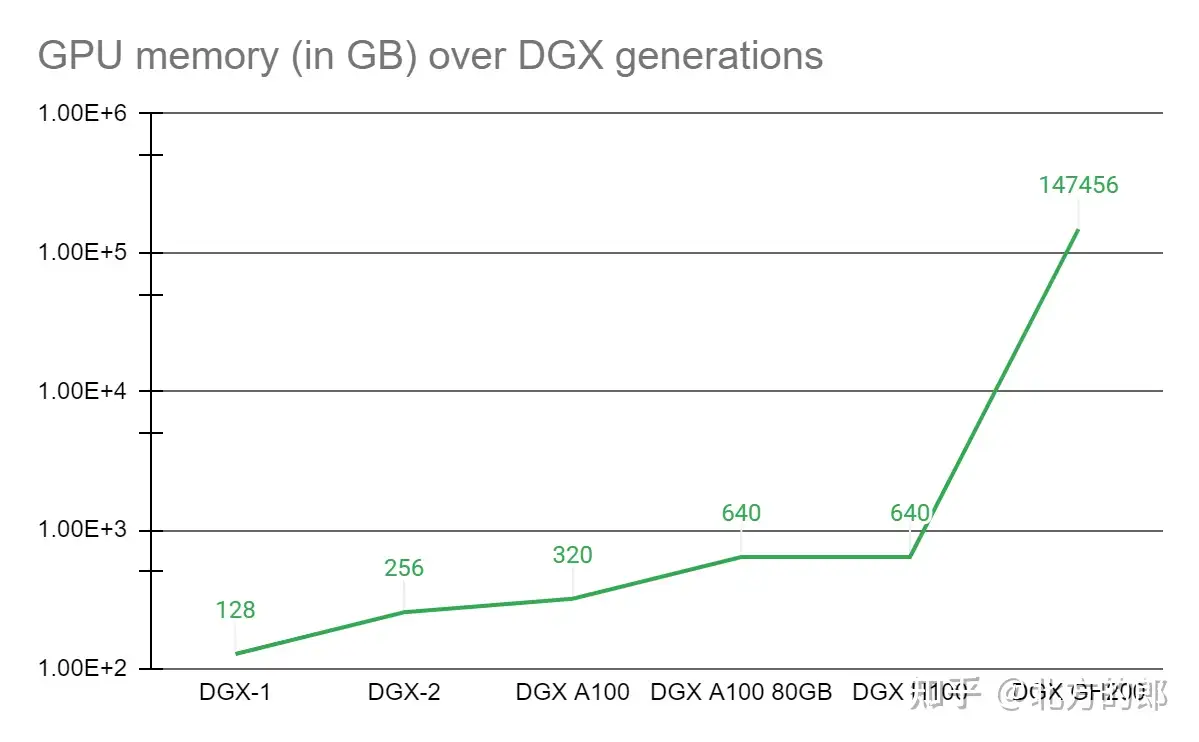

从那时起,每个 DGX 系统的核心都是基板上的 GPU 复合体,基板上与 NVLink 互连,其中每个 GPU 都可以以 NVLink 速度访问对方的内存。许多此类带有 GPU 复合体的 DGX 通过高速网络互连,形成更大的超级计算机,例如NVIDIA Selene 超级计算机。然而,一类新兴的巨型万亿参数 AI 模型要么需要几个月的训练时间,要么即使在当今最好的超级计算机上也无法解决。

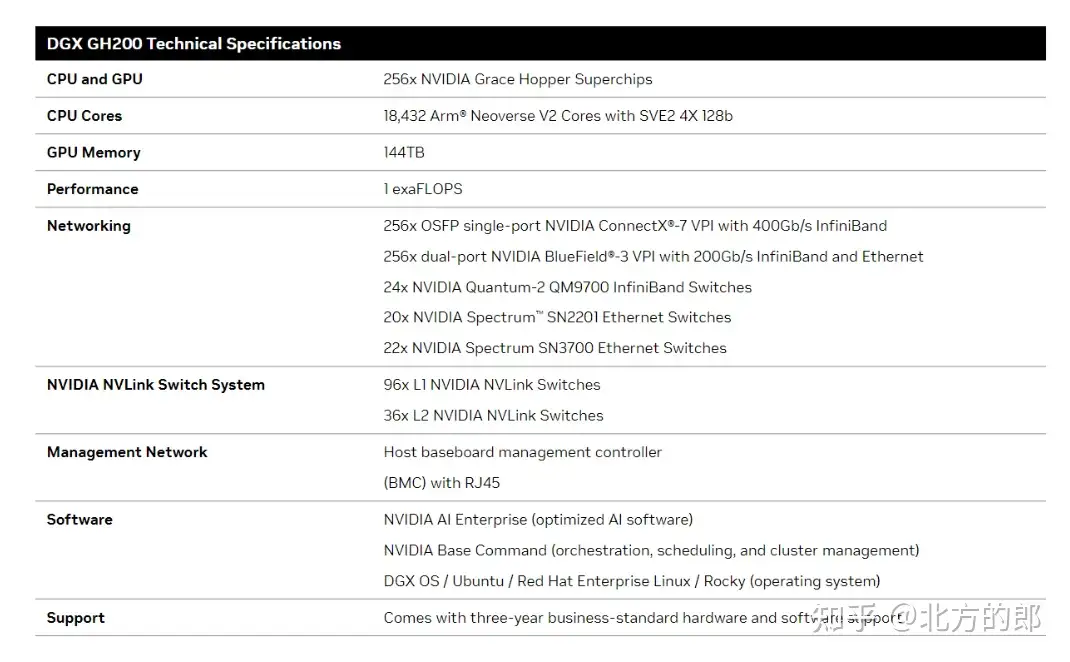

NVIDIA 将NVIDIA Grace Hopper Superchip与 NVLink 开关系统配对,在 NVIDIA DGX GH200 系统中整合了多达 256 个 GPU。在 DGX GH200 系统中,GPU 共享内存编程模型可通过 NVLink 高速访问 144 TB 内存。

与单个NVIDIA DGX A100 320 GB 系统相比,NVIDIA DGX GH200 通过 NVLink 为 GPU 共享内存编程模型提供了近 500 倍的内存,形成了一个巨大的数据中心大小的 GPU。NVIDIA DGX GH200 是第一台突破 GPU 通过 NVLink 访问内存的 100 TB 障碍的超级计算机。

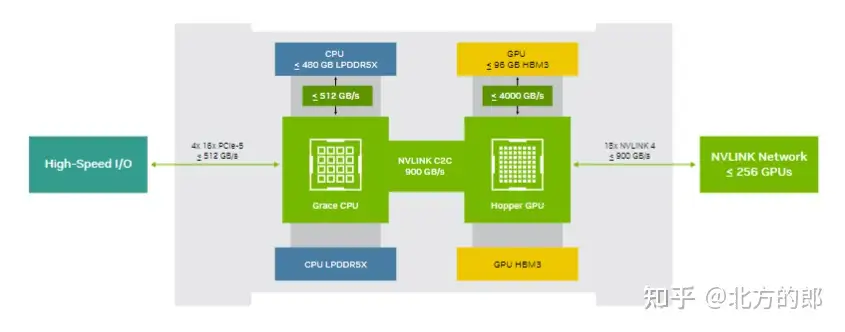

NVIDIA Grace Hopper Superchip 和 NVLink Switch System 是 NVIDIA DGX GH200 架构的构建块。NVIDIA Grace Hopper Superchip 使用NVIDIA NVLink-C2C结合了 Grace 和 Hopper 架构,以提供 CPU + GPU 一致性内存模型。由第四代 NVLink 技术提供支持的 NVLink 开关系统将 NVLink 连接扩展到超级芯片,以创建无缝、高带宽、多 GPU 系统。

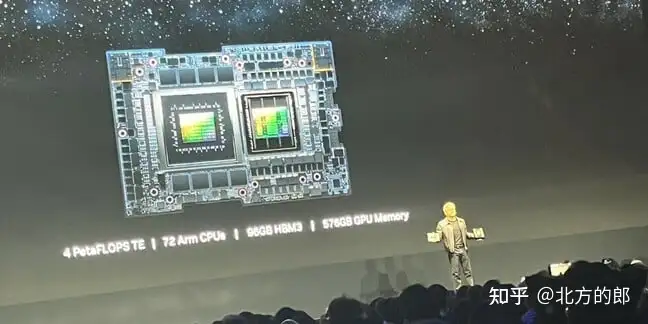

NVIDIA DGX GH200 中的每个 NVIDIA Grace Hopper Superchip 都有 480 GB LPDDR5 CPU 内存,每 GB 的功率是 DDR5 和 96 GB 的快速 HBM3 的八分之一。NVIDIA Grace CPU 和 Hopper GPU 与 NVLink-C2C 互连,以五分之一的功率提供比 PCIe Gen5 多 7 倍的带宽。

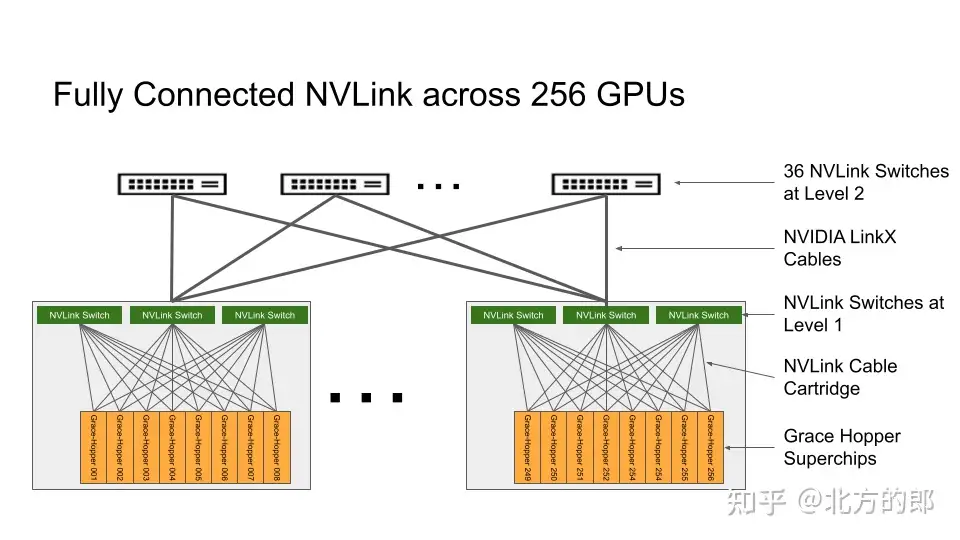

NVLink 交换机系统形成了一个两级、无阻塞、胖树 NVLink 结构,可在 DGX GH200 系统中完全连接 256 个 Grace Hopper 超级芯片。DGX GH200 中的每个 GPU 都可以 900 GBps 访问其他 GPU 的内存和所有 NVIDIA Grace CPU 的扩展 GPU 内存。

托管 Grace Hopper Superchips 的计算底板使用用于第一层 NVLink 结构的定制线束连接到 NVLink 开关系统。LinkX 电缆扩展了 NVLink 结构第二层的连接性。

在 DGX GH200 系统中,GPU 线程可以使用 NVLink 页表寻址来自 NVLink 网络中其他 Grace Hopper 超级芯片的对等 HBM3 和 LPDDR5X 内存。NVIDIA Magnum IO加速库优化 GPU 通信以提高效率,增强所有 256 个 GPU 的应用程序扩展。

DGX GH200 中的每个 Grace Hopper Superchip 都与一个NVIDIA ConnectX-7网络适配器和一个NVIDIA BlueField-3 NIC配对。DGX GH200 拥有 128 TBps 对分带宽和 230.4 TFLOPS 的 NVIDIA SHARP 网内计算,可加速 AI 中常用的集体操作,并通过减少集体操作的通信开销,将 NVLink 网络系统的有效带宽提高一倍。

为了扩展到超过 256 个 GPU,ConnectX-7 适配器可以互连多个 DGX GH200 系统以扩展到更大的解决方案。BlueField-3 DPU 的强大功能可将任何企业计算环境转变为安全且加速的虚拟私有云,使组织能够在安全的多租户环境中运行应用程序工作负载。

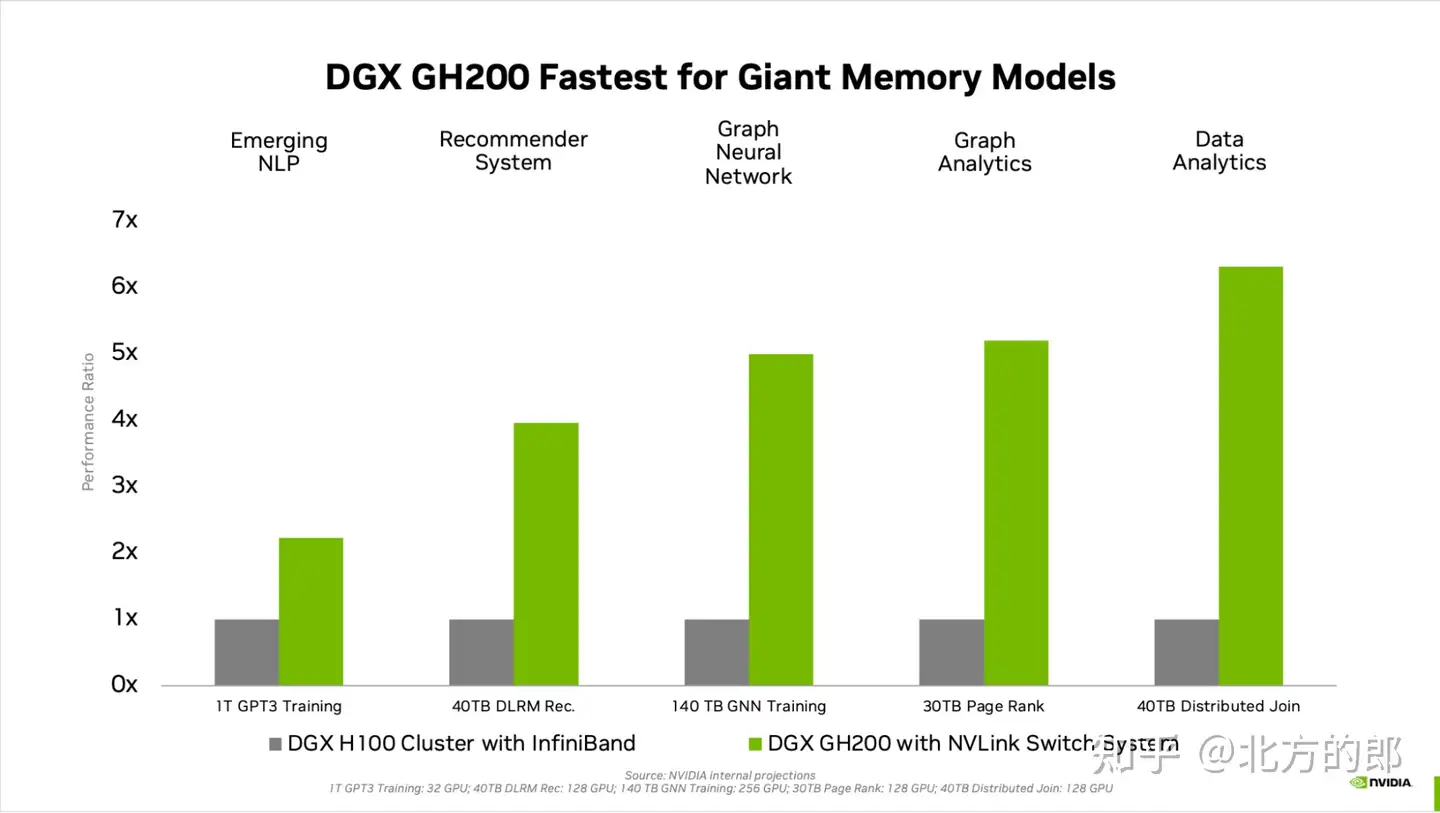

GPU 内存的代际飞跃显着提高了受 GPU 内存大小瓶颈的 AI 和 HPC 应用程序的性能。许多主流 AI 和 HPC 工作负载可以完全驻留在单个NVIDIA DGX H100的聚合 GPU 内存中。对于此类工作负载,DGX H100 是性能效率最高的训练解决方案。

其他工作负载——例如具有 TB 级嵌入式表的深度学习推荐模型 (DLRM)、TB 级图形神经网络训练模型或大型数据分析工作负载——使用 DGX GH200 可实现 4 至 7 倍的加速。这表明 DGX GH200 是更高级的 AI 和 HPC 模型的更好解决方案,这些模型需要海量内存来进行 GPU 共享内存编程。

NVIDIA Grace Hopper Superchip Architecture白皮书中详细描述了加速机制。

DGX GH200 中的每个组件都经过精心挑选,以最大限度地减少瓶颈,同时最大限度地提高关键工作负载的网络性能,并充分利用所有扩展硬件功能。结果是线性可扩展性和海量共享内存空间的高利用率。

为了充分利用这个先进的系统,NVIDIA 还构建了一个极高速的存储结构,以峰值容量运行并处理各种数据类型(文本、表格数据、音频和视频)——并行且稳定表现。

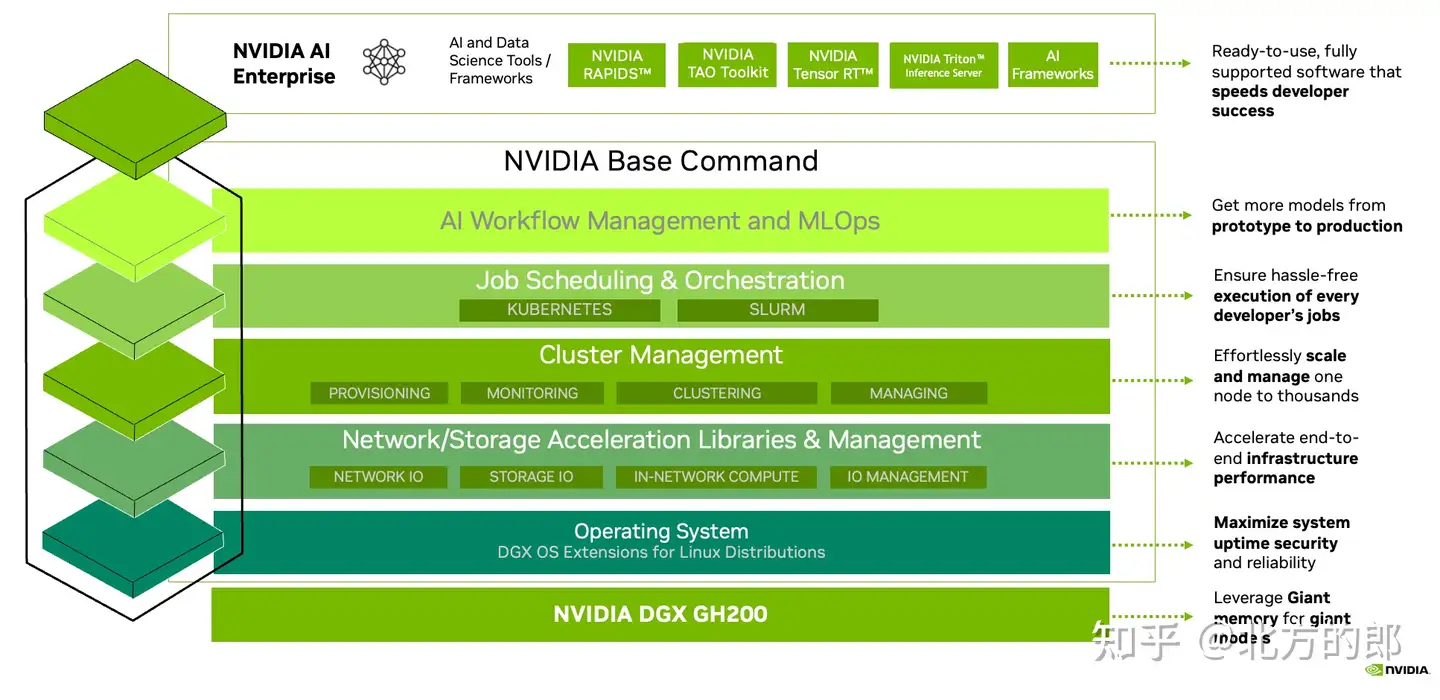

DGX GH200 附带NVIDIA Base Command,其中包括针对 AI 工作负载优化的操作系统、集群管理器、加速计算的库、存储和网络基础设施,这些都针对 DGX GH200 系统架构进行了优化。

DGX GH200 还包括NVIDIA AI Enterprise,提供一套优化的软件和框架,以简化 AI 开发和部署。这种全堆栈解决方案使客户能够专注于创新,而不必担心管理其 IT 基础架构。

NVIDIA 正致力于在今年年底推出 DGX GH200。NVIDIA 渴望提供这款令人难以置信的同类首台超级计算机,让您能够创新并追求激情,解决当今最大的 AI 和 HPC 挑战。

巨型模型的巨型内存

NVIDIA DGX GH200 是唯一一款在 256 个NVIDIA Grace Hopper 超级芯片上提供 144TB 海量共享内存空间的 AI 超级计算机,为开发人员提供近 500 倍的内存来构建巨型模型。

超级节能计算

Grace Hopper 超级芯片通过在同一封装上结合NVIDIA Grace™ CPU和NVIDIA Hopper™ GPU ,消除了对传统 PCIe CPU 到 GPU 连接的需求,将带宽提高了 7 倍,并将互连功耗降低了 5 倍以上。

集成并准备运行

通过交钥匙 DGX GH200 部署,在数周而不是数月内构建巨型模型。这个全栈数据中心级解决方案包括来自 NVIDIA 的集成软件和白手套服务,从设计到部署,以加快 AI 的投资回报率

NVIDIA Grace Hopper架构将NVIDIA Hopper GPU的突破性性能与NVIDIA Grace CPU的多功能性融合在单个超级芯片中,通过高带宽、内存一致性的NVIDIA,NVLink,Chip-2-Chip(C2C)互连连接在一起。

NVIDIA NVLink-C2C是一种内存一致性、高带宽、低延迟的超级芯片互连。作为Grace Hopper超级芯片的核心,它提供高达900GB/s的总带宽,比加速系统中常用的PCIe Gen5通道高7倍。NVLink-C2C使应用程序能够超量使用GPU的内存,并直接以高带宽利用NVIDIA Grace CPU的内存。每个Grace Hopper超级芯片最多可提供480GB的LPDDR5X CPU内存,使GPU能够直接访问比HMB3多7倍的快速内存。结合NVIDIA NVLink交换系统,通过最多256个NVLink连接的GPU上运行的所有GPU线程可以以高带宽访问高达150TB的内存。

Announcing NVIDIA DGX GH200: The First 100 Terabyte GPU Memory System | NVIDIA Technical Blog